[이코리아] 언론계에서 AI 기술의 활용이 늘어가는 가운데, AI 기술이 가짜 정보의 확산을 부채질하고 저널리즘의 신뢰성을 훼손할 수 있다는 우려가 커지고 있다.

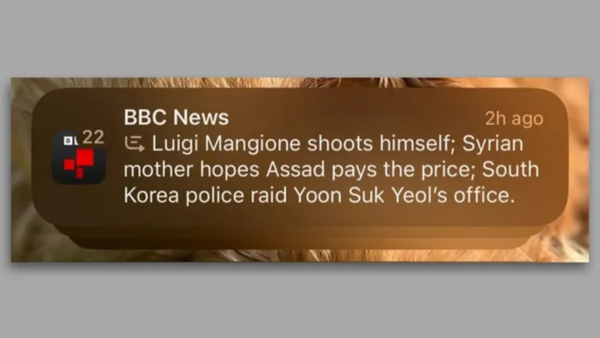

14일 BBC는 애플의 AI 서비스 '애플 인텔리전스'의 AI 기반 뉴스 요약이 뉴욕에서 발생한 CEO 살인 사건 관련 보도를 잘못 요약해 전했다며 비판했다. AI 요약 기능이 뉴욕에서 발생한 CEO 살인 사건과 관련된 BBC의 보도를 요약하는 과정에서 가해자가 스스로 목숨을 끊었다는 잘못된 정보를 포함했다는 것이다.

= BBC 갈무리

BBC 대변인은 "BBC 뉴스는 세계에서 가장 신뢰받는 뉴스 미디어다. 시청자들이 우리 이름으로 게시되는 모든 정보나 저널리즘을 신뢰할 수 있어야 하며 여기에는 알림이 포함된다."라며 이번 문제를 해결하기 위해 애플 측에 연락했다고 밝혔다.

AI가 저널리즘의 신뢰를 위협한 사례는 BBC뿐만이 아니다. 지난달에는 뉴욕타임즈 역시 AI의 잘못된 기사 요약으로 인한 오보로 곤혹을 치뤘다. AI가 국제형사재판소가 네타냐후 이스라엘 총리에 대한 체포영장을 발부했다는 내용을 네타냐후 총리가 체포되었다는 내용으로 잘못 요약해 이용자들에게 전달한 것이다.

또 다른 사례로, 일론 머스크의 AI 챗봇 ‘그록(Grok)’이 도널드 트럼프 피격 사건 직후 “카멀라 해리슨 부통령이 총에 맞았다”라는 잘못된 기사를 생성하며 논란을 빚었다. 또 총격범의 이름과 배경 정보를 잘못 표기하고, 총격범이 극단적 이념 집단과 관련되어 있다는 등 검증되지 않은 정보를 기사에 포함시켜 혼란을 가중시켰다는 비판도 받았다.

= 연구 본문 갈무리

AI가 뉴스 제작에 미치는 영향을 조사한 다수의 연구 결과에서도 저널리즘의 신뢰성에 AI 기술이 악영향을 미칠 수 있다는 우려가 제시된다. 캔자스대가 최근 내놓은 연구에 따르면, AI를 활용해 쓰여진 뉴스는 독자들에게 신뢰도가 낮게 평가되는 경향이 나타났다.

연구에 따르면 독자들은 기사에 AI가 얼마나 관여했는지를 인식하는 방식에 따라 그 기사의 신뢰도를 다르게 평가하는 경향을 보였다. 연구진은 AI의 기여 수준을 다섯 가지 조건(인간 기자 작성, AI 도구, AI 보조자, AI 협력자, AI 저자)으로 나누어 기사에 명시한 뒤, 독자들이 이를 어떻게 인식하는지를 조사했다.

그 결과 AI의 기여도가 명확히 드러날수록 독자들은 AI를 저자로 인식하는 비율이 높아졌으며, AI의 관여도가 높다고 인식될수록 독자들이 기사의 인간적 특성과 신뢰성을 의심한다는 결과가 나타났다. 이에 따라 연구진은 AI의 개입에 대한 모호함이나 공개 부족은 독자들이 소비하는 뉴스에 대한 신뢰를 떨어뜨릴 수 있으며, AI가 뉴스 제작에 참여하더라도 인간이 주도적 역할을 한다는 점을 명확히 알리고 결과물을 철저히 검증해야 독자의 신뢰를 유지할 수 있다고 강조했다.

또 유럽의 언론 연구 싱크탱크 '미디어 및 저널리즘 연구 센터(MJRC)'는 언론인들이 주로 사용하는 AI 도구가 대부분 이해관계와 엮인 기업이 소유한 도구라는 점을 지적하는 연구를 내놓았다.

보고서는 언론인이 자주 사용하는 100개의 AI 도구 중 67%가 소유권과 재정 정보를 충분히 공개하지 않는다고 지적했으며, AI 도구의 개발자와 투자자의 배경을 이해하지 못하면 그 도구가 생성하는 결과물이 특정 이해관계에 의해 왜곡될 가능성을 배제할 수 없다고 경고했다. 또 이는 언론인들이 AI를 사용해 보도한 콘텐츠의 신뢰성에 악영향을 미칠 수 있으며, 나아가 독자와 대중의 저널리즘에 대한 신뢰를 저하시킬 수 있다고도 덧붙혔다.

보고서는 이러한 문제를 해결하기 위해, AI 도구를 개발하는 기업들은 소유권, 재정적 배경, 그리고 알고리즘의 설계 과정에 대한 더 많은 정보를 공개해야 하며, 언론사 또한 AI 도구를 사용할 때 그 출처와 기능, 그리고 잠재적 한계에 대해 독자에게 명확하게 밝혀야 한다고 주장했다. 투명성을 강화하고 윤리적 기준을 지키는 것이야말로 AI 시대의 저널리즘이 신뢰를 유지하는 핵심이라는 것이다. 이에 더해 AI 도구의 투명성과 책임성을 모니터링하기 위한 장기적 연구와 협력 역시 필요하다는 점 역시 강조했다.

한편 세계 각국의 언론계는 AI에 대응하기 위한 공동 대응에 나섰다. 지난해 11월에는 국경없는기자회(RSF)와 주요 언론단체들이 '인공지능과 저널리즘을 위한 파리 헌장'을 발표했다. 파리 헌장은 미디어 내 기술 선택에서 윤리를 중시하도록 하고, 인간이 편집권에 있어 중심이 되도록 하고, 미디어는 사회가 진짜와 가짜 콘텐츠를 구별할 수 있도록 도와야 하며, 언론사 글로벌 AI 거버넌스에 참여하고 기술 기업과 협상할 때 저널리즘의 생존을 지키도록 하는 등의 내용이 담겼다.

그러나 세계신문협회(WAN-IFRA)는 헌장의 현실성과 실행 가능성에 의구심을 드러내며 독립적 평가 요구에 반대 입장을 표명하기도 했다.

국내의 경우 지난 5일, 한국언론진흥재단과 6개 언론인 단체가 AI를 활용한 뉴스 제작의 원칙을 담은 '언론을 위한 생성형 인공지능 준칙’을 발표했다. 이 준칙은 AI 기술이 뉴스 생산을 보조하는 도구로 활용되어야 하며, 철저한 사실 확인과 인간의 관리·감독을 전제로 한다고 명확히 규정했다.

특히 AI가 생성한 결과물이 기술적 한계로 인해 부정확하거나 허구적인 내용을 포함할 가능성이 크다고 지적하며, 철처한 검증과 사실 확인, 책임의 명확화, 그리고 활용 범위의 한계 설정을 강조했다.

※참고자료

Haiyan Jia, Alyssa Appelman, Mu Wu, Steve Bien-Aimé, 'News bylines and perceived AI authorship: Effects on source and message credibility', Computers in Human Behavior: Artificial Humans 2 (2024) 100093, 2024 (www.journals.elsevier.com/computers-in-human-behavior-artificial-humans)

Sydney Martin, 'CONTROL BEYOND CODE: Ownership and Financial Insights of AI Used in Journalism', Media and Journalism Research Center, 2024

한국기자협회, '언론을 위한 생성형 인공지능 준칙'

현기호 기자

저작권자 이코리아 무단전재 및 재배포 금지

더 많은 기사는 '이코리아'(http://www.ekoreanews.co.kr/)

'ICT' 카테고리의 다른 글

| [체험기] 챗 GPT 서치 무료 개방, 정확도는? (2) | 2024.12.19 |

|---|---|

| 치지직 '스트리머 생태계 고도화' vs SOOP '글로벌, e스포츠 강화' (3) | 2024.12.19 |

| 말레이시아 신행정수도에서 살펴본 스마트시티의 미래 (2) | 2024.12.19 |

| 'X-odus(엑소더스)' 현상...그 많던 이용자들은 어디로 갔을까? (3) | 2024.12.13 |

| 구글, '제미나이 2.0'기반의 AI 에이전트 선보여...주요 기능은? (3) | 2024.12.12 |